HDR to jedna z tych technologii, które realnie zmieniły sposób, w jaki odbieramy obraz – zarówno na ekranach telewizorów, monitorów, jak i smartfonów. Jeszcze kilka lat temu rozdzielczość była głównym wyznacznikiem jakości, dziś jednak coraz większą rolę odgrywa zakres dynamiki, czyli zdolność do jednoczesnego pokazywania bardzo jasnych i bardzo ciemnych elementów sceny. To właśnie tutaj HDR (High Dynamic Range) robi największą różnicę.

Dzięki HDR obraz staje się bardziej zbliżony do tego, co widzi ludzkie oko – jaśniejsze światła nie są przepalone, a detale w cieniach nie giną w czerni. Efekt? Większy realizm, głębia i intensywniejsze kolory, które potrafią całkowicie odmienić odbiór filmów, seriali czy gier.

W tym artykule przyjrzymy się, czym dokładnie jest HDR, jak działa oraz na co zwrócić uwagę przy wyborze sprzętu, który faktycznie pozwoli wykorzystać jego możliwości.

Zapraszamy do naszej recenzji Samsung SmartTV z 2022 QE55QN91BA

w inteligentnym domu SmartThings

Definicja HDR

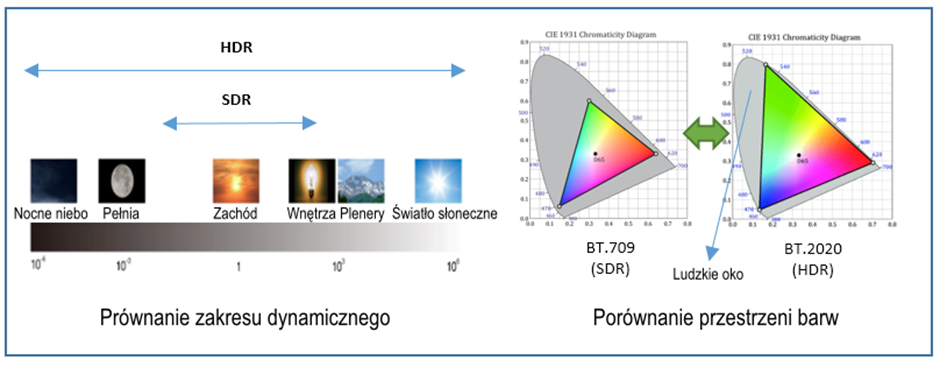

HDR to skrót od High Dynamic Range i oznacza technologię, która rozszerza zakres jasności i możliwości odwzorowania kolorów obrazów w porównaniu do standardowego SDR. Umożliwia tworzenie oraz odtwarzanie bardziej żywych, realistycznych obrazów — bliższych temu, co postrzega ludzkie oko. Technologia HDR zachowuje szeroki zakres jasności wewnątrz jednego obrazu — od intensywnego światła słonecznego po światło gwiazd na najciemniejszym nocnym niebie — oraz wykorzystuje najszerszy zakres kolorów, który może być postrzegany przez człowieka.

HDR najczęściej korzysta z danych 10-bitowych lub większych, aby uzyskać płynniejsze przejścia kolorystyczne. 10 bitów pozwala na uzyskanie ponad tysiąca odcieni każdego z podstawowych kolorów, kiedy 8 bit pozwala wyłącznie na 256.

Proces od uchwycenia obrazu HDR, przez jego przetworzenie, aż po finalne wyświetlenie wygląda następująco:

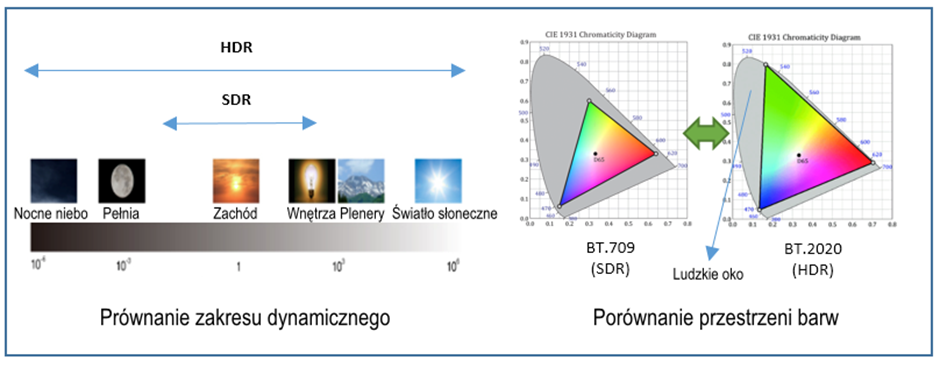

Aby uchwycić obraz jak najbardziej zbliżony do rzeczywistości, stosuje się wysokiej jakości czujnik, który rejestruje materiał z szerszą przestrzenią barw, większą głębią koloru oraz wyższym współczynnikiem kontrastu. Następnie w procesie masteringu tworzony jest optymalny obraz HDR, który jest kompresowany i przesyłany jako gotowy plik.

Otrzymany obraz HDR jest finalnie wyświetlany z wykorzystaniem mapowania tonów oraz technologii konwersji kolorów, tak aby dopasować go do specyfikacji wyświetlacza użytkownika.

Rodzaje HDR – czym się różnią i co to oznacza w praktyce?

Istnieje kilka rodzajów HDR: HLG, HDR10, HDR10+ oraz Dolby Vision.

Obecnie Samsung Galaxy S25 obsługuje HLG, HDR10 oraz HDR10+ (na podstawie renderingu).

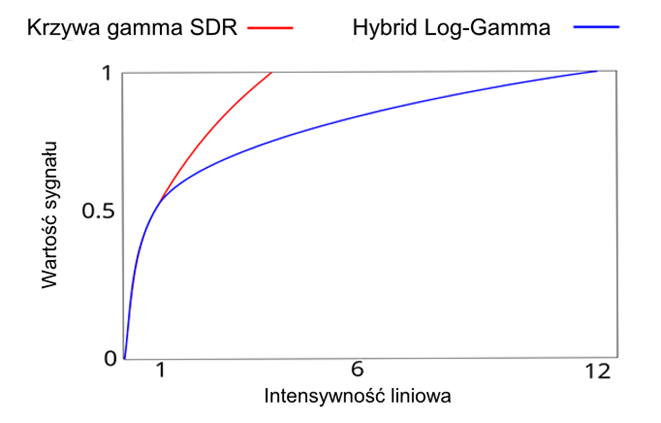

Największe różnice pomiędzy poszczególnymi typami HDR dotyczą krzywej gamma określającej sposób odwzorowania jasności oraz rodzaju metadanych wykorzystywanych do interpretacji obrazu HDR.

| Typ HDR | Krzywa gamma | Metadane |

| HLG | HLG | Brak |

| HDR10 | PQ | Metadane statyczne |

| HDR10+ | PQ | Metadane dynamiczne |

| Dolby Vision | HLG/PQ | Metadane dynamiczne |

Te różnice sprawiają, że każdy rodzaj HDR jest interpretowany nieco inaczej.

Technologia HDR (High Dynamic Range) pozwala uzyskać obraz o znacznie większej rozpiętości jasności, lepszym kontraście oraz bardziej realistycznych kolorach niż w przypadku standardowego SDR. W praktyce oznacza to, że jednocześnie widzimy więcej szczegółów w bardzo jasnych i bardzo ciemnych fragmentach sceny. Warto jednak pamiętać, że HDR nie jest jednolitym standardem – istnieje kilka jego odmian, które różnią się sposobem przetwarzania obrazu.

HLG (Hybrid Log-Gamma), opracowany przez BBC oraz NHK, został zaprojektowany głównie z myślą o transmisjach telewizyjnych. Jego największą zaletą jest brak konieczności stosowania metadanych – obraz automatycznie dostosowuje się do możliwości odbiornika. Dzięki temu HLG dobrze sprawdza się w transmisjach na żywo i jest kompatybilny także ze starszymi telewizorami, które nie obsługują pełnego HDR.

Najbardziej rozpowszechnionym standardem jest HDR10. To otwarty format wykorzystywany przez większość producentów sprzętu oraz platform streamingowych. W HDR10 stosowane są tzw. statyczne metadane, co oznacza, że ustawienia jasności i kolorów są takie same dla całego materiału wideo. Choć zapewnia to wyraźną poprawę jakości względem SDR, w bardziej wymagających scenach – np. z dużymi różnicami jasności – jego możliwości są ograniczone.

Rozwinięciem tego standardu jest HDR10+, współtworzony m.in. przez Samsung. W przeciwieństwie do HDR10 wykorzystuje on dynamiczne metadane, które pozwalają na optymalizację obrazu scena po scenie. Dzięki temu detale w jasnych i ciemnych partiach są lepiej zachowane, a obraz wygląda bardziej naturalnie. Co ważne, HDR10+ pozostaje standardem otwartym, niewymagającym opłat licencyjnych.

Najbardziej zaawansowanym rozwiązaniem jest Dolby Vision, rozwijany przez Dolby Laboratories. Podobnie jak HDR10+, wykorzystuje dynamiczne metadane, ale oferuje jeszcze większą precyzję odwzorowania obrazu oraz obsługę nawet 12-bitowej głębi kolorów. Przekłada się to na jeszcze płynniejsze przejścia tonalne i bardziej szczegółowy obraz. Wadą tego standardu jest konieczność posiadania odpowiedniej licencji oraz kompatybilnego sprzętu.

Kluczowe różnice pomiędzy tymi standardami dotyczą przede wszystkim sposobu zarządzania jasnością obrazu, czyli tzw. krzywej gamma (a dokładniej funkcji EOTF), oraz wykorzystania metadanych. HLG stosuje własną, hybrydową krzywą dostosowaną do transmisji, natomiast HDR10, HDR10+ i Dolby Vision bazują na krzywej PQ (Perceptual Quantizer), która pozwala na bardzo precyzyjne odwzorowanie jasności zgodnie z tym, jak postrzega ją ludzkie oko. Dodatkowo różnice w metadanych – statycznych lub dynamicznych – mają bezpośredni wpływ na to, jak dobrze obraz jest dopasowany do konkretnej sceny.

Platformy VOD a standard obrazu

Platformy VOD w dużym stopniu kształtują dziś standardy obrazu HDR, jednak różnią się obsługiwanymi formatami. Netflix oferuje treści głównie w HDR10 oraz Dolby Vision – przy czym Dolby Vision, dzięki dynamicznym metadanym, zapewnia lepsze dopasowanie jasności i kolorów scena po scenie. Z kolei Amazon Prime Video stawia na HDR10 i HDR10+, gdzie HDR10+ również wykorzystuje dynamiczne metadane, stanowiąc otwartą alternatywę dla Dolby Vision.

Różnice między Dolby Vision a HDR10+ są niewielkie z perspektywy widza, ale istotne technologicznie i biznesowo. Dolby Vision jest rozwiązaniem licencjonowanym, szeroko stosowanym m.in. przez producentów takich jak Apple czy LG, natomiast HDR10+ rozwijany jest m.in. przez Samsung i częściej spotykany w jego telewizorach. W praktyce wybór platformy i sprzętu determinuje, który standard HDR zostanie wykorzystany podczas oglądania.

Co ciekawe, HDR przestał być domeną wyłącznie profesjonalnych produkcji – smartfony takie jak Apple iPhone umożliwiają nagrywanie wideo bezpośrednio w Dolby Vision. Oznacza to, że użytkownicy mogą tworzyć materiały o jakości zbliżonej do tej znanej z platform VOD, z zachowaniem wysokiego kontrastu, szerokiej palety barw i dynamicznego odwzorowania jasności.

Jak różnice wpływają na odbiór filmu ?

Przykład Samsunga i 10-bitowy HDR w Galaxy S25

Jedną z największych zmian w 10-bitowym HDR w Galaxy S25 jest nagrywanie HDR.

Do tej pory domyślnym ustawieniem było nagrywanie SDR, ale od modelu Galaxy S25 domyślnym ustawieniem jest nagrywanie HDR.

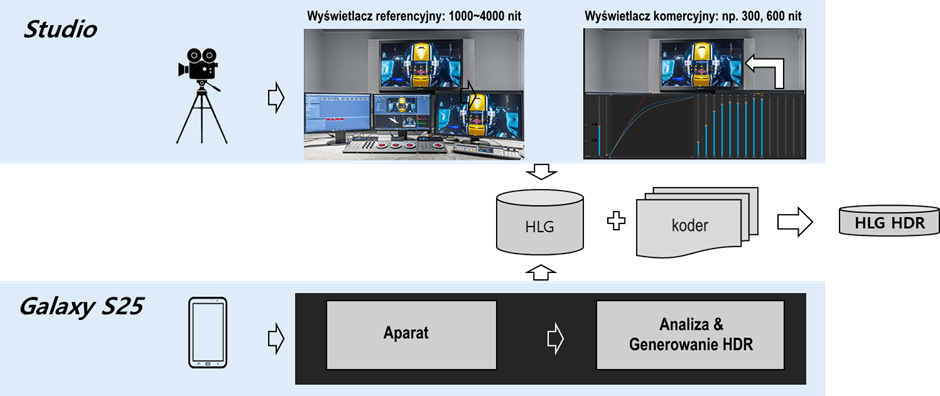

Format HDR używany w nagrywaniu domyślnym to HLG (Hybrid Log-Gamma) — standard HDR opracowany przez BBC i NHK, który charakteryzuje się brakiem dodatkowych metadanych zapisanych materiale filmowym.

Nawet bez dodatkowych metadanych, własne mapowanie tonów HLG pozwala na interpretację materiału zgodnie z jasnością wyświetlacza. Co ważne, format ten zapewnia bardzo dobrą kompatybilność – ma wiele nakładających się sekcji z istniejącą gamą SDR, co stanowi ogromną zaletę przy udostępnianiu nagrań z zachowaniem jakości HDR.

Na przykład, nawet jeśli urządzenie odbierające materiał HDR nie obsługuje przetwarzania HDR, nagranie nadal będzie widoczne bez blaknięcia kolorów czy przesycenia, choć oczywiście jakość nie będzie tak wysoka jak w trybie HDR.

Jeśli chodzi o produkcję profesjonalnych treści, takich jak filmy HDR, proces ten obejmuje etap precyzyjnego masteringu z wykorzystaniem kosztownego sprzętu w specjalistycznych studiach.

Na tym etapie reżyser filmu często jest bezpośrednio zaangażowany w kwestie takie jak kolorystyka, jasność itp., a jakość obrazu HDR może również zależeć od tego, ile wysiłku reżyser, kolorysta i ekspert HDR włożą w mastering, aby dokładnie odzwierciedlić intencje producenta.

W Galaxy S25 zautomatyzowano i uproszczono kluczowe elementy profesjonalnego masteringu, aby smartfon mógł zapewnić jak najlepszą jakość obrazu, nie tylko na etapie nagrywania, ale także finalnego wyświetlania. Osiągnęli to poprzez optymalizację technologii renderingu.

W przypadku smartfonów, takich jak Samsung Galaxy S25, wsparcie dla HDR obejmuje HLG, HDR10 oraz HDR10+. Oznacza to, że użytkownik może liczyć na bardzo dobrą jakość obrazu, szczególnie w materiałach wykorzystujących dynamiczne metadane HDR10+. Brak wsparcia dla Dolby Vision jest typowy dla urządzeń Samsunga i wynika głównie z kwestii licencyjnych, a nie technologicznych ograniczeń.

Podsumowanie

Podsumowując, wybór standardu HDR ma realny wpływ na jakość obrazu. HDR10 stanowi solidną bazę, HDR10+ i Dolby Vision oferują wyższą jakość dzięki dynamicznym metadanym, natomiast HLG pozostaje najlepszym rozwiązaniem dla transmisji telewizyjnych. W codziennym użytkowaniu różnice te są najbardziej widoczne w scenach o dużym kontraście – tam, gdzie HDR naprawdę pokazuje swoją przewagę.

- [1] Modele obsługiwane: seria Galaxy S25. Funkcja nie jest dostępna na wcześniejszych modelach, ponieważ wymaga określonego wsparcia sprzętowego i nie może być dodana poprzez aktualizacje systemu.